Universal Robots og Scale AI lancerer nyt system for imitationslæring, der accelererer AI modeltræning og forkorter vejen fra laboratorie til fabrik

San Jose, Californien, 18. marts 2026: Universal Robots (UR) præsenterede i denne uge UR AI Trainer på NVIDIA GTC 2026 i Silicon Valley. AI Trainer er udviklet i samarbejde med Scale AI og er en klar markering af, at robotter bevæger sig fra forprogrammerede applikationer til fuldt ud AI‑drevne opgaver. Disse systemer er drevet af robuste datasæt genereret i AI‑træningsceller, hvor robotter imiterer menneskelige bevægelser.

“Vores kunder – lige fra store virksomheder til AI‑forskningslaboratorier – efterspørger ikke længere blot AI‑funktioner,” siger Anders Billesø Beck, Vice President for AI Robotics Products hos Universal Robots. “De har brug for at indsamle synkroniserede robot‑ og visionsdata i høj kvalitet for at kunne træne AI‑modeller på de samme robotter, som de ønsker at implementere i produktionen. Vores AI Trainer er branchens første direkte laboratorie‑til‑fabrik‑løsning til AI‑modeltræning.”

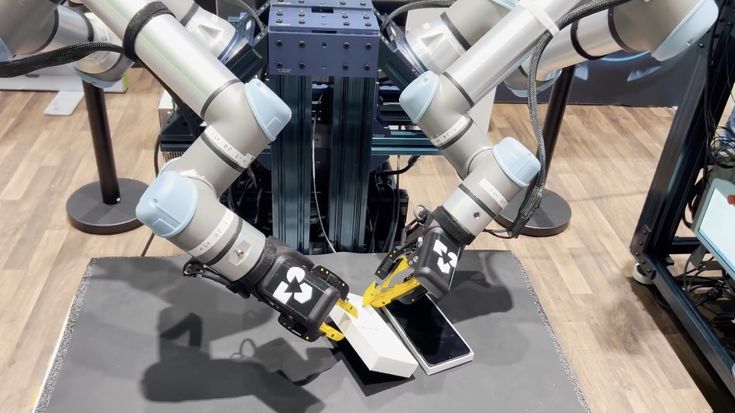

Udover lanceringen af AI Trainer viser Universal Robots på sin stand til GTC også en topmoderne robotic foundation model fra Generalist AI - en foretrukken modelpartner for UR. Ved at bruge denne model vil to UR‑robotter udføre en kompleks pakkeopgave af en smartphone, som kun er blevet mulig takket være de seneste fremskridt inden for fysisk AI.

Muliggør AI klar dataindsamling med Direct Torque Control

Træning af AI‑robotter hæmmes ofte af fragmenteret hardware og dataindsamling i lav kvalitet. En stor del af nutidens træningsdata indsamles på forskningsrobotter, der ikke er egnede til industrimiljøer, og mange systemer baserer sig udelukkende på visuel feedback, hvilket gør sarte eller kontaktintensive opgaver vanskelige.

“AI Trainer adresserer direkte disse barrierer,” siger Anders Billesø Beck. “Ved at udnytte vores unikke Direct Torque Control og kraftfeedback-funktioner giver vi udviklere direkte indflydelse på, hvordan robotten fysisk interagerer med verden – og giver dem mulighed for at træne og udvikle data på den samme robuste hardware, som anvendes i mere end 100.000 industrielle installationer verden over.”

Partnerskab med Scale AI muliggør et integreret, selvforstærkende kredsløb

AI Trainer gør det muligt for menneskelige operatører at føre UR-robotter gennem opgaver i et leader-follower-setup, samtidig med at der automatisk indsamles multimodale data i høj kvalitet til udvikling af robot-AI. Konkret guider operatøren fysisk en “leader”-robot gennem en opgave, mens en synkroniseret “follower”-robot spejler bevægelsen i realtid. Under hver demonstration registrerer systemet synkroniserede bevægelses-, kraft- og visionsdata og skaber dermed de strukturerede datasæt, der kræves til træning af VLA-modeller (Vision Language Action).

Ved implementering på UR’s AI Accelerator platform kombinerer AI Trainer UR-robotter med Scale AI-software og muliggør dataindsamling på UR-robotter i produktion og i stor skala. Det skaber en kontinuerlig feedbacksløjfe, som driver løbende optimering af fysiske AI-systemer.

“Universal Robots er førende inden for industrirobotter, og deres globale tilstedeværelse udgør det ideelle fundament for dataindsamling og implementering af AI‑foundation‑modeller i stor skala,” siger Ben Levin, General Manager for Physical AI hos Scale AI.

“Sammen har vi skabt et integreret, selvforstærkende kredsløb af robotdata, der gør det muligt for kunder at træne, implementere og forbedre deres AI‑modeller hurtigere end nogensinde før.”

Som led i samarbejdet vil UR og Scale AI senere i år offentliggøre et storstilet industrielt opgavedatasæt indsamlet på UR‑robotter.

Tæt samarbejde med NVIDIA

Processen med at indsamle robot‑træningsdata til AI‑modeller demonstreres også ved en demo, der viser den samme smartphone‑pakkeopgave – denne gang trænet virtuelt. Den simulerede opsætning er bygget i NVIDIA Omniverse og anvender Isaac Sim og gør det muligt for deltagerne at styre et virtuelt, to‑armet UR3e‑system med haptisk feedback i realtid ved hjælp af to Haply Inverse3‑enheder som “leaders”.

Universal Robots udforsker også brugen af NVIDIA Physical AI Data Factory Blueprint til at automatisere og skalere genereringen af syntetiske data og dermed omdanne verdensomspændende regnekraft til en motor for robottræningsdata i høj kvalitet.

“Overgangen til Physical AI kræver et grundlæggende skifte fra rigid, forprogrammeret automatisering til generalist‑robotter, der kan opfatte, ræsonnere og lære gennem menneskelignende interaktion,” siger Amit Goel, Head of Robotics and Edge AI Ecosystem hos NVIDIA. “Ved at udnytte NVIDIA Isaac‑simulering opbygger Universal Robots en skalerbar motor til dataindsamling og datagenerering i høj kvalitet og leverer den nødvendige infrastruktur til at træne næste generation af autonome systemer i stor skala.”

- Universal Robots A/S

- Energivej 51

- 5260 Odense S