LANCIANO UN SISTEMA DI IMITATION LEARNING PER ACCELERARE L’ADDESTRAMENTO DEI MODELLI DI AI, COLMANDO IL DIVARIO TRA LABORATORIO E FABBRICA

San Jose, California, 17 marzo 2026: Universal Robots (UR) ha presentato oggi UR AI Trainer al GTC 2026, nella Silicon Valley. Sviluppato in collaborazione con Scale AI, AI Trainer consente un cambiamento radicale nel momento in cui i robot passano da applicazioni pre-programmate a compiti interamente guidati dall’intelligenza artificiale. Questi sistemi sono alimentati da dati robusti generati in celle di addestramento AI in cui i robot imitano gli esseri umani.

«I nostri clienti, che spaziano dalle grandi imprese ai laboratori di ricerca sull’AI, non chiedono più soltanto funzionalità di intelligenza artificiale», ha dichiarato Anders Beck, VP of AI Robotics Products di Universal Robots. «Hanno bisogno di un modo per raccogliere dati robotici e visivi sincronizzati, ad alta fedeltà, per addestrare modelli di AI sugli stessi robot che intendono poi implementare. Il nostro AI Trainer è la prima soluzione del settore che collega direttamente laboratorio e fabbrica per l’addestramento di modelli di AI.»

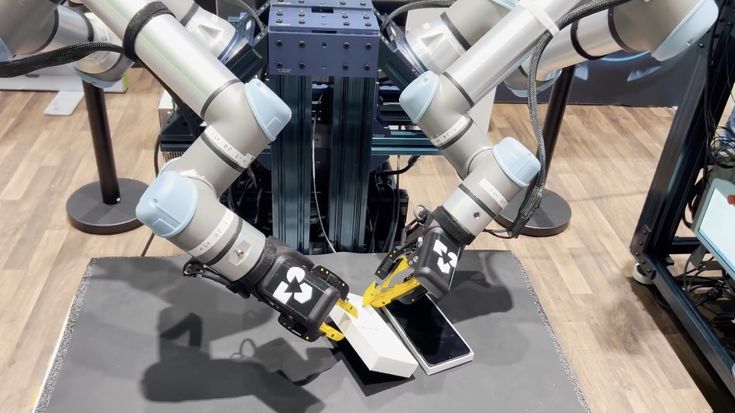

Accanto al nuovo AI Trainer, lo stand di Universal Robots al GTC presenterà un robotic foundation model all’avanguardia sviluppato da Generalist AI, partner preferenziale di UR per i modelli. Sfruttando questo modello, due robot UR completeranno una complessa attività di confezionamento di smartphone, in precedenza impossibile senza i recenti progressi nel campo della Physical AI.

Abilitare la raccolta di dati pronti per l’AI con force feedback e direct torque control

L’addestramento dell’AI in ambito robotico è spesso ostacolato da hardware frammentato e da una raccolta dati a bassa fedeltà. Gran parte dei dati di training oggi viene raccolta su robot di ricerca non adatti agli ambienti produttivi, e molti sistemi si basano soltanto sul feedback visivo, rendendo difficili i compiti delicati o ad alto contatto. "AI Trainer affronta direttamente queste barriere», ha dichiarato Beck."Sfruttando il nostro esclusivo Direct Torque Control e le funzionalità di force feedback, diamo agli sviluppatori un controllo diretto sul modo in cui il robot interagisce fisicamente con il mondo, addestrandosi sullo stesso hardware robusto già impiegato in oltre 100.000 installazioni industriali"

La partnership con Scale AI abilita un flywheel integrato di dati robotici

AI Trainer consente agli operatori umani di guidare i robot UR nello svolgimento di attività in una configurazione leader-follower, acquisendo automaticamente dati multimodali di alta qualità per lo sviluppo dell’AI robotica. Gli operatori guidano fisicamente un robot “leader” durante un’attività, mentre un robot “follower” sincronizzato replica il movimento in tempo reale. Durante ogni dimostrazione, il sistema registra in modo sincronizzato dati di movimento, forza e visione, producendo i dataset strutturati necessari per addestrare modelli Vision-Language-Action (VLA).

Implementato sulla piattaforma AI Accelerator di UR, UR AI Trainer combina i robot UR con il software di Scale AI per consentire la raccolta dati sui robot UR in produzione e su larga scala, generando un feedback continuo che alimenta l’ottimizzazione costante dei sistemi di Physical AI.

"Universal Robots è un leader della robotica industriale e la sua presenza globale offre la base ideale per la raccolta dei dati e l’implementazione dell’AI", ha dichiarato Ben Levin, General Manager, Physical AI di Scale AI. "Insieme abbiamo creato un flywheel integrato di dati robotici, che consente ai clienti di addestrare, implementare e migliorare i propri modelli di AI più rapidamente che mai." Nell’ambito di questa collaborazione, UR e Scale AI rilasceranno entro la fine dell’anno un dataset industriale su larga scala raccolto su robot UR.

Esperienza diretta con AI Trainer al GTC

Con il GTC come piattaforma ufficiale di lancio, i partecipanti potranno sperimentare il sistema in prima persona allo stand di UR, guidando due robot UR3e “leader” che forniscono input aptico per controllare due robot UR7e “follower”. La configurazione permette ai visitatori di eseguire una complessa attività di confezionamento di smartphone con feedback aptico per l’imitation learning e l’addestramento VLA, con dati dimostrativi registrati in tempo reale sullo stack di Scale e riproducibili direttamente sull’AI Trainer.

Il processo di acquisizione dei dati di addestramento robotico per i modelli di AI sarà inoltre mostrato attraverso una demo che illustra la stessa attività di confezionamento di smartphone, ma addestrata virtualmente: realizzato in NVIDIA Omniverse e sfruttando Isaac Sim, il setup simulato consente ai partecipanti di controllare un sistema virtuale bi-manuale UR3e con feedback aptico in tempo reale, utilizzando due dispositivi Haply Inverse3 come “leader”, offrendo una simulazione fisicamente accurata.

Universal Robots sta inoltre esplorando l’uso del blueprint NVIDIA Physical AI Data Factory per automatizzare e scalare la generazione di dati sintetici, trasformando una capacità di calcolo su scala mondiale in un motore produttivo per dati di addestramento robotico di alta qualità.

"Il passaggio verso la Physical AI richiede un cambiamento fondamentale: dall’automazione rigida e pre-programmata a robot generalisti in grado di percepire, ragionare e apprendere attraverso un’interazione simile a quella umana", ha dichiarato Amit Goel, head of robotics and edge AI ecosystem di NVIDIA. "Sfruttando i framework di simulazione NVIDIA Isaac, Universal Robots sta costruendo un motore scalabile per la raccolta e la generazione di dati ad alta fedeltà, fornendo l’infrastruttura essenziale per addestrare su larga scala la prossima generazione di sistemi autonomi."

Generalist AI dimostra le prestazioni reali dei robotic foundation model

A completare le due dimostrazioni dedicate alla raccolta dati, la presentazione di Generalist mette in evidenza come i progressi nella raccolta dei dati e nei modelli di AI si traducano in prestazioni robotiche nel mondo reale. Nella prima dimostrazione pubblica dei foundation model embodied di Generalist, due robot UR7e eseguono in autonomia una complessa attività di confezionamento di smartphone, dimostrando destrezza, coordinazione e capacità di manipolazione ad alto contatto in un ambiente reale. La dimostrazione mostra come dati di training scalati e di alta qualità, combinati con architetture di modello di frontiera, possano abilitare sistemi di Physical AI robusti oltre il laboratorio.

"Generalist sta sviluppando foundation model embodied che offrono livelli di destrezza e affidabilità leader nel settore», ha dichiarato Pete Florence, co-founder e CEO di Generalist AI. «Questa dimostrazione sulla piattaforma industriale affidabile di Universal Robots mostra come una precisa percezione dell’ambiente fisico possa essere tradotto in capacità operative nel mondo reale, aprendo la strada a implementazioni su larga scala in diversi settori."

"L’adozione della nostra tecnologia da parte dei pionieri dell’addestramento dei modelli di AI e della raccolta dati conferma perché Universal Robots è diventata la piattaforma preferita per la Physical AI" ha dichiarato Anders Beck di UR.

- Universal Robots Italia

- Via Lessolo, 3

- 10153 Torino TO