Sistemi di visione e robotica collaborativa: guida all’integrazione perfetta

I sistemi di visione sono una tecnologia avanzata che oramai viene utilizzata in maniera crescente anche nell’ambito della robotica collaborativa. La combinazione dei sistemi di visione con i cobot ha scopi specifici perché consente di elevare ulteriormente caratteristiche essenziali come la precisione (e quindi la ripetibilità delle operazioni) ma anche la sicurezza.

I sistemi di visione sono una tecnologia avanzata che oramai viene utilizzata in maniera crescente anche nell’ambito della robotica collaborativa. La combinazione dei sistemi di visione con i cobot ha scopi specifici perché consente di elevare ulteriormente caratteristiche essenziali come la precisione (e quindi la ripetibilità delle operazioni) ma anche la sicurezza. Questa particolare estensione del cobot rappresenta uno strumento che consente ai robot collaborativi di vedere e pensare meglio. Oggi affrontiamo l’ambito di sistemi di visione e cobot in:

- Cosa sono i sistemi di visione

- Occhi per vedere, occhi per pensare

- Guida all’integrazione dei sistemi di visione

- Conclusioni

Cosa sono i sistemi di visione

I sistemi di visione utilizzano hardware e software che combinati insieme consentono di acquisire ed elaborare immagini. Si potrebbe dire che “scattano fotografie” o effettuano “riprese”, tuttavia la natura delle informazioni visive è tanto particolare quanto particolare è l’applicazione associata al sistema. I sistemi di visione sono generalmente formati da una fotocamera la quale è predisposta per acquisire immagini “crude”. Queste immagini vengono poi inviate all’unità di elaborazione che, attraverso algoritmi specifici, consente al sistema:

- L’identificazione: i sistemi di visione possono essere predisposti per il riconoscimento in base a determinati parametri. Ad esempio identificare con precisione un difetto su di un pezzo come anche leggere le informazioni da barcode o Qrcode.

- La misurazione: questa funzione è indispensabile per individuare ad esempio i pezzi fuori tolleranza (che magari hanno passato il controllo dei difetti) oppure per il posizionamento esatto di particolari da assemblare.

- Il rilevamento: non solo misure e difetti; i sistemi di visione possono ad esempio rilevare temperature (attraverso telecamere termiche) durante i processi di saldatura oppure nello stampaggio a caldo

I sistemi di visione, come abbiamo visto in questi semplici esempi, possono quindi essere basati su impostazioni multi parametriche. Essi diventano, anzi, sono diventati assolutamente indispensabili per un gran numero di applicazioni industriali.

Occhi per vedere, occhi per pensare

E’ noto che i cobot, per poter compiere i loro movimenti, si basano sulle coordinate degli assi x, y e z**.** Cosa potrebbe succedere se il cobot, oltre ad avere le coordinate di movimento, inizi anche a “vedere”? Potrebbe orientarsi meglio nell’area di lavoro e, durante le fasi di identificazione, rilevamento e manipolazione andrebbe a migliorare ulteriormente l'efficienza delle operazioni. Come è facilmente intuibile, per fare ciò, il sistema di visione da solo non basta. Infatti, i sistemi di visione sono legati ad algoritmi di intelligenza artificiale, ovvero parliamo di machine e deep learning. Attraverso l’AI si addestrano gli algoritmi in modo che il cobot faccia “gavetta”, utilizzare l’esperienza, ampliare la proprie capacità di “pensiero” e valutare di volta in volta l’azione più efficace.

Guida all’integrazione dei sistemi di visione

Finora ci siamo concentrati sul “dopo”, tuttavia va considerata anche la parte che riguarda il “prima” ovvero quali aspetti vanno considerati per poter implementare correttamente i sistemi di visione nella robotica collaborativa. Il primo consiglio è quello di evitare il “fai da te” se non si è particolarmente ferrati in materia ma di appoggiarsi sempre a figure con esperienza, quindi produttori come UR o anche System Integrator.

I passi da compiere per l’integrazione sono:

- Valutazione e identificazione delle reali esigenze: essere visionari è una gran cosa, tuttavia occorre individuare con esattezza ciò che serve davvero piuttosto che intraprendere un percorso più consono a un reparto R&D che all’automatizzazione di un processo produttivo. Questo concetto sembra scontato, tuttavia in questa fase è facile “perdere la bussola” se non si hanno ben chiari gli obiettivi (e un esperto che fornisca i giusti consigli).

- Scelta dei dispositivi: nell’ambito dei sistemi di visione, la scelta dei dispositivi può essere davvero ampia. Questo aspetto è strettamente correlato al punto precedente e quindi avrà come effetto: esigenze chiare – scelta del dispositivo ottimale – integrazione più rapida – risparmio di tempo prezioso

- Integrazione: a questo punto si passa alla configurazione vera e propria del sistema di visione ossia predisporre il “cosa deve fare”. La configurazione avviene tramite software HMI e protocolli di comunicazione standard. In questo modo il cobot e il sistema di visione possono comunicare e avviare l’interazione.

- Tocca al software: se il passo precedente prevedeva la configurazione del sw HMI adesso è il turno degli algoritmi dei sistemi di visione e dell’IA. Questa fase è fondamentale per il corretto funzionamento della visione e per dare modo all’AI di “fare esperienza”. Ad esempio, nel caso di un sistema con riconoscimento di difetti di superficie, l’algoritmo AI andrà addestrato con la fornitura di una grande quantità di immagini campione (si del particolare perfetto che difettato). L’algoritmo avrà a disposizione una casistica con cui effettuare paragoni ed individuare con facilità crescente i difetti.

Test e messa a punto: arrivati fin qui, non resta che verificare il corretto funzionamento di tutto il sistema. Ma non è tutto… Se per quanto integrazione e programmazione possano essere state effettuate correttamente occorre l’ultima messa a punto. La calibrazione consente di ottimizzare le prestazioni del sistema poiché si va ad intervenire sulle tolleranze e “sfumature”

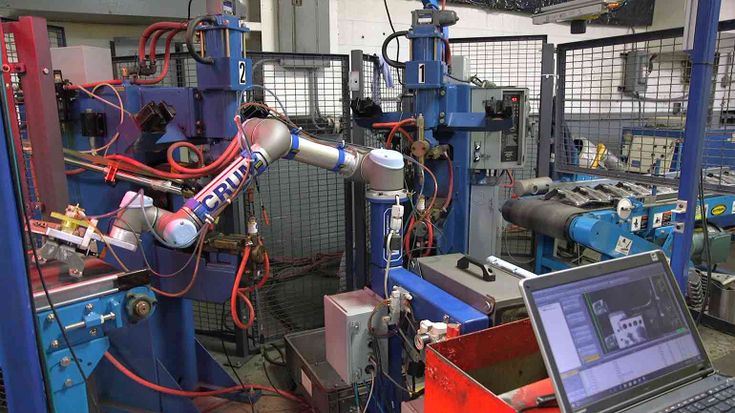

Questi, in sostanza, sono i passi necessari per l’implementazione dei sistemi di visione sui robot collaborativi. I cobot UR sono strumenti flessibili e di facile utilizzo, anche per tutti coloro che non hanno una grande esperienza in termini di programmazione robotica. I sistemi di visione come anche l’ampio portfolio di accessori consentono ai robot collaborativi UR di elevare ulteriormente le loro prestazioni e ottimizzarne il rendimento.

- Universal Robots Italia

- Via Lessolo, 3

- 10153 Torino TO