ユニバーサルロボット、 ネクストスケープの「RoboLens®」をUR+製品として認証

ユニバーサルロボット、ネクストスケープの「RoboLens®」をUR+製品として認証

Mixed Reality デバイスを活用し、協働ロボットの現場導入やティーチングを 簡単・効率的・直感的にアシスト

ユニバーサルロボット(本社:デンマーク、日本支社:東京都港区、日本支社代表:山根 剛、以下「UR」))は、株式会社ネクストスケープ(本社:東京都港区、代表取締役社長: 小杉 智、以下「ネクストスケープ」)が開発するMixed Reality(MR)を活用したロボット導入支援・ティーチングソリューション「RoboLens®」を、ユニバーサルロボット製協働ロボット(以下「URロボット」)の周辺機器プラットフォーム「UR+」製品として認証したことを発表します。

ネクストスケープのRoboLensは、MR技術を活用して簡単、効率的、直感的にロボットの現場導入やティーチングをアシストする次世代のソリューションです。ロボットの導入や動作検証をアシストする「RoboLens Layout」と、ロボットの教示を助ける「RoboLens Teaching」の2種が展開されています。いずれもMicrosoft社のMRゴーグル HoloLens2を使い、透過性のあるレンズで現実世界を見ながら、仮想物体を表示させます。

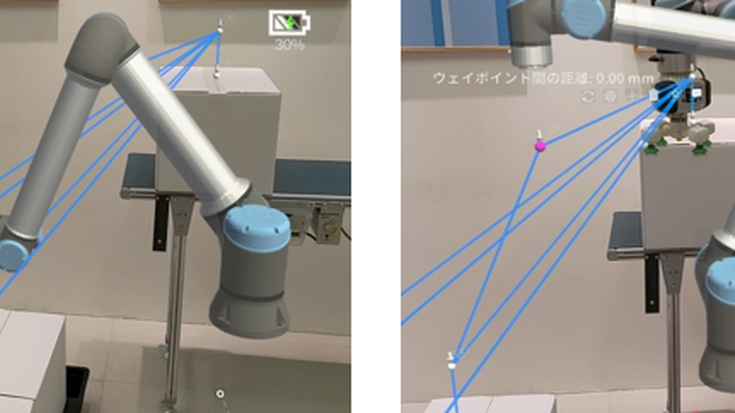

RoboLens Layoutは、MR技術を活用したロボットの配置・動作検証ソリューションです。ロボットの導入を検討する場合、現場にロボットを持ち込んで動作検証するか、3Dシミュレータを用いて動きを確認する必要がありますが、稼働中のラインで動作検証を行うのは難しく、また3Dシミュレータを用いるにはコストがかかる、という課題がありました。

RoboLens Layoutを活用すると、MRゴーグルを通して現場の空間上に仮想のURロボットを表示し、配置・動作の検証をすることができるようになります。稼働中の機器に影響を与えずに検証できる上、検証結果をシステムの設計や開発に反映させることも可能となります。

(左)仮想ロボットを表示し配置・動作検証後 (右)検証結果に合わせて実機を設置

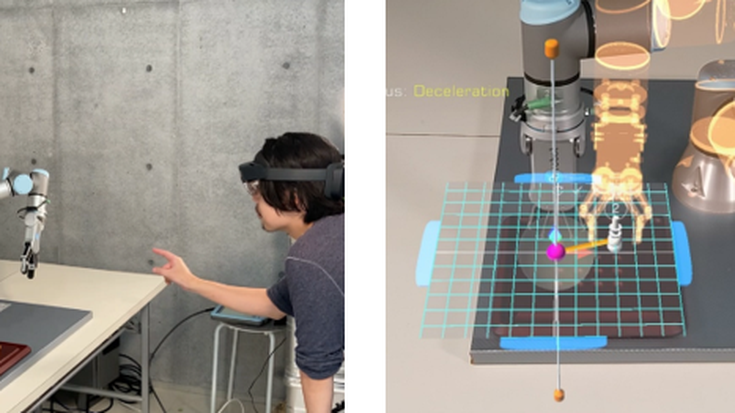

RoboLens Teachingは、ロボットの設置後に行う教示作業をアシストするツールです。HoroLens2を通してロボット実機にホログラムを重ね、ジェスチャ操作で簡単かつ効率的にロボットを移動したり、記録したりできるようになります。また、目の前の空間に3D表示されるロボットの動作軌跡を確認しながら、より安全に作業ができるようになります。

RoboLens Teaching 操作のようす

UR+は、URロボットとプラグ&プレイで使える周辺機器のプラットフォームです。ロボットアームの仕様やインターフェースをオープンにし、それらに準拠するエンドエフェクタ、カメラ、センサなどの周辺機器をデベロッパが開発します。URによる検証、認証を経てデベロッパがUR+製品として販売します。

ユニバーサルロボット 日本支社代表 山根 剛は次のように述べています。「現在、世界で460以上の製品がUR+製品として登録されていますが、今回ネクストスケープが開発したRoboLensは世界でも類を見ない斬新なソリューションです。URロボットの実機がなくても配置検証ができることでユーザーへの提案機会は格段に広がりますし、MRを使ったジェスチャ操作で教示ができることもユニークです。新たなユーザー層の獲得につながることを期待しています」

ネクストスケープ 代表取締役社長 小杉 智は次のように述べています。「当社の強みの1つであるMixed Realityを活用し、協働ロボットの導入プロセスをより直感的にする『RoboLens』を開発しました。協働ロボットの普及を推進し、社会の生産性向上に貢献したいと考えています。今後もデジタルツインやメタバースの活用による現場と遠隔地の連携を実現するなど、新たな価値の創出に取り組んでまいります」

RoboLens Teachingは 2023年5月にリリースしました。RoboLens Layoutは2023年7月にBeta版をリリースする予定です。