Universal Robots i Scale AI prezentują system uczenia przez naśladowanie, który przyspiesza rozwój modeli AI i eliminuje lukę między badaniami a wdrożeniami przemysłowymi

Warszawa, 20 marca 2026: Universal Robots (UR) zaprezentowało rozwiązanie UR AI Trainer podczas GTC 2026 w Dolinie Krzemowej. Opracowany we współpracy ze Scale AI, AI Trainer stanowi istotny krok naprzód, ponieważ roboty przestają być jedynie zaprogramowane do konkretnych zadań i zaczynają działać w oparciu o sztuczną inteligencję. Kluczową rolę odgrywają tu wysokiej jakości dane generowane w środowiskach treningowych, w których roboty uczą się przez naśladowanie człowieka.

„Nasi klienci, od dużych przedsiębiorstw po laboratoria badawcze AI, nie pytają już tylko o pojedyncze funkcje oparte na sztucznej inteligencji” — powiedział Anders Beck, VP of AI Robotics Products w Universal Robots. *„*Potrzebują skutecznego sposobu na zbieranie wysokiej jakości, zsynchronizowanych danych z robotów i systemów wizyjnych, by trenować modele AI na tych samych robotach, które zamierzają wdrożyć. Nasz AI Trainer to pierwsze w branży rozwiązanie, które bezpośrednio łączy laboratorium z halą produkcyjną w procesie trenowania modeli AI.”

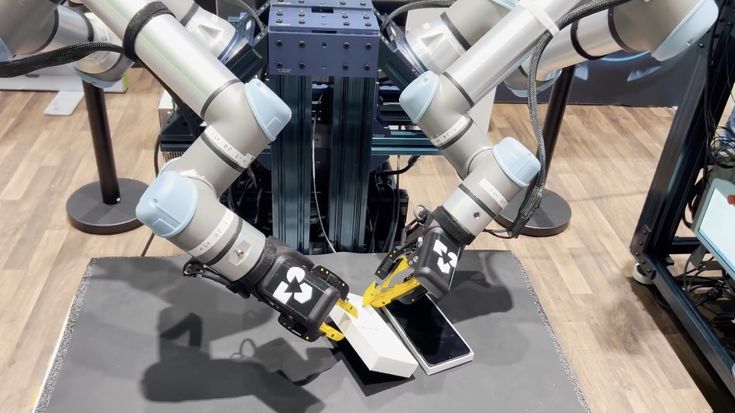

Obok nowego AI Trainera na stoisku Universal Robots podczas GTC zaprezentowano zaawansowany model bazowy robotyki opracowany przez Generalist AI - preferowanego partnera UR w tym obszarze. Dzięki temu modelowi dwa roboty UR wykonają skomplikowane zadanie pakowania smartfonów, a więc operację, która jeszcze do niedawna, bez najnowszych osiągnięć w obszarze fizycznej sztucznej inteligencji (Physical AI), była nieosiągalna.

Zbieranie danych gotowych do wykorzystania przez AI dzięki sprzężeniu zwrotnemu i bezpośredniemu sterowaniu momentem obrotowym

Szkolenie robotów AI jest często utrudnione przez rozproszony sprzęt oraz niską jakość pozyskiwanych danych. Wiele współczesnych danych treningowych zbieranych jest na robotach badawczych, które nie są przystosowane do środowisk produkcyjnych. Dodatkowo wiele systemów opiera się wyłącznie na analizie obrazu, co sprawia, że precyzyjne zadania wymagające kontaktu fizycznego stają się bardzo trudne. „AI Trainer bezpośrednio odpowiada na te wyzwania” - mówi Anders Beck. „Wykorzystując unikalne funkcje Direct Torque Control oraz sprzężenie zwrotne, deweloperzy zyskują realną kontrolę nad fizyczną interakcją robota z otoczeniem i mogą trenować modele na dokładnie tym samym, sprawdzonym sprzęcie, który działa już w ponad 100 000 zastosowań przemysłowych.”

Partnerstwo ze Scale AI umożliwia stworzenie zintegrowanego obiegu danych robotycznych

AI Trainer pozwala operatorom prowadzić roboty UR przez zadania w układzie lider-naśladowca, automatycznie gromadząc przy tym wysokiej jakości dane multimodalne potrzebne do rozwoju robotyki AI. Operatorzy fizycznie prowadzą robota zwanego „leaderem” przez zadanie, podczas gdy zsynchronizowany robot, tzw. „follower”, odwzorowuje ruch w czasie rzeczywistym. Podczas każdej demonstracji system rejestruje zsynchronizowane dane ruchu, siły i dane wizyjne, tworząc ustrukturyzowane zbiory danych wymagane do trenowania modeli Vision-Language-Action (VLA).

UR AI Trainer, działając na platformie UR AI Accelerator, łączy roboty UR z oprogramowaniem Scale AI, umożliwiając zbieranie danych na robotach UR w środowisku produkcyjnym i na dużą skalę. Tworzy to ciągłą pętlę informacji zwrotnej, która napędza proces nieprzerwanej optymalizacji systemów Physical AI.

„Universal Robots jest jedną z wiodących firm w dziedzinie robotyki przemysłowej, a jego globalna obecność stanowi idealną podstawę do zbierania danych i wdrażania AI” - powiedział Ben Levin, General Manager, Physical AI w Scale AI. „Wspólnie stworzyliśmy zintegrowany obieg danych robotycznych, który pozwala klientom trenować, wdrażać i ulepszać modele AI szybciej niż kiedykolwiek wcześniej.” W ramach tej współpracy UR i Scale AI opublikują jeszcze w tym roku obszerny, przemysłowy zbiór danych zebranych na robotach UR.

Bezpośrednie spotkania z AI Trainer na GTC

GTC stało się miejscem oficjalnej premiery systemu. Uczestnicy konferencji mogli osobiście przetestować AI Trainer na stoisku UR, prowadząc dwa roboty UR3e, odgrywające role „liderów" i dostarczające sygnały haptyczne do sterowania dwoma robotami UR7e w rolach „naśladowców”. Dzięki temu odwiedzający mogli wykonać złożone zadanie pakowania smartfonów, korzystając ze sprzężenia haptycznego, które umożliwia zbieranie danych do uczenia przez imitację oraz treningu modeli VLA. Dane demonstracyjne rejestrowano w czasie rzeczywistym w środowisku Scale z możliwością odtworzenia bezpośrednio w narzędziu AI Trainer.

Proces pozyskiwania danych treningowych dla modeli AI zaprezentowano również w formie demonstracji tego samego zadania pakowania smartfonów — tym razem wytrenowanego w środowisku wirtualnym. Zbudowane w NVIDIA Omniverse z wykorzystaniem Isaac Sim, wirtualne stanowisko pozwalało uczestnikom sterować symulowanym dwuręcznym systemem UR3e z haptycznym sprzężeniem zwrotnym w czasie rzeczywistym, używając dwóch urządzeń Haply Inverse3 jako „liderów". To zapewnia symulację zgodną z prawami fizyki.

Universal Robots eksploruje także możliwości wykorzystania NVIDIA Physical AI Data Factory Blueprint do automatyzacji i skalowania procesu generowania danych syntetycznych, przekształcając globalną moc obliczeniową w wydajny „silnik produkcyjny” wysokiej jakości danych treningowych dla robotów.

„Rozwój Physical AI wymaga odejścia od sztywnej, z góry zaprogramowanej automatyzacji na rzecz robotów bardziej uniwersalnych, zdolnych do postrzegania, wnioskowania i uczenia się poprzez interakcję zbliżoną do ludzkiej” — mówi Amit Goel, Head of Robotics and Edge AI Ecosystem w NVIDIA. „Dzięki wykorzystaniu środowisk symulacyjnych NVIDIA Isaac, Universal Robots buduje skalowalną infrastrukturę do pozyskiwania i generowania wysokiej jakości danych, niezbędnych do trenowania nowej generacji autonomicznych systemów na dużą skalę.”

Generalist AI pokazuje realne możliwości modeli robotycznych nowej generacji

Dwie demonstracje gromadzenia danych uzupełniła prezentacja firmy Generalist, pokazująca, w jaki sposób postępy w zbieraniu danych i rozwoju modeli AI przekładają się na rzeczywistą wydajność robotów. W pierwszej publicznej demonstracji embodied foundation models (modeli AI działających w świecie fizycznym) przygotowanej przez Generalist dwa roboty UR7e autonomicznie wykonają złożone zadanie pakowania smartfonów, demonstrując wysoką precyzję, koordynację oraz zaawansowaną manipulację obiektami w rzeczywistych warunkach. Pokaz ilustruje, jak wysokiej jakości dane treningowe zbierane na dużą skalę, w połączeniu z najnowocześniejszymi architekturami modeli, mogą tworzyć wydajne systemy fizycznej AI działające poza środowiskiem laboratoryjnym.

„Generalist buduje embodied foundation models, które wyznaczają standardy w zakresie precyzji i niezawodności - mówi Pete Florence, współzałożyciel i CEO Generalist AI. „Demonstracja na zaufanej, przemysłowej platformie Universal Robots pokazuje, jak tzw. fizyczny ‘zdrowy rozsądek’ może zostać przełożony na realne zastosowania, torując drogę do wdrożeń w różnych branżach na dużą skalę.”

„Fakt, że nasza technologia jest wykorzystywana przez liderów w obszarze trenowania modeli AI i pozyskiwania danych, pokazuje, dlaczego Universal Robots stało się preferowaną platformą dla Physical AI” — podkreśla Anders Beck z UR, który wystąpił również podczas panelu GTC „Beyond the Workcell: Scaling Robotics Workflows Across the Factory Floor”.

- Universal Robots A/S

- Kateřinská 466/40

- 12000 Praha